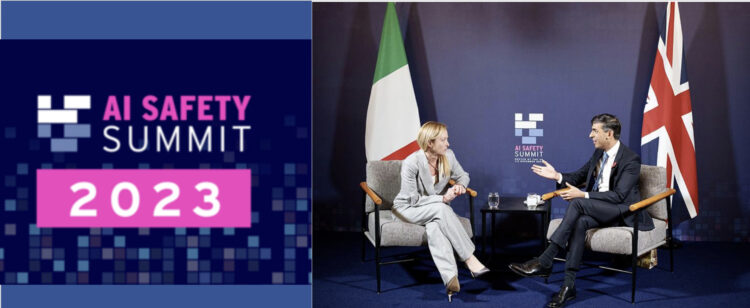

La Primera Ministra, Giorgia Meloni, durante la Cumbre de Seguridad de la Inteligencia Artificial que se celebró en Bletchley Park, mantuvo una reunión bilateral con el Primer Ministro del Reino Unido, Rishi Sunak, Ambos discutieron los principales temas bilaterales e internacionales, la presidente Meloni también confirmó que la inteligencia artificial será uno de los temas centrales de la presidencia italiana del G7 el próximo año.

Por primera vez, altos representantes gubernamentales de los principales países de IA y las principales organizaciones de IA acuerdan un plan para realizar pruebas de seguridad de los modelos de IA de vanguardia.

El plan implica probar modelos antes y después del despliegue, y un papel para los gobiernos en las pruebas, particularmente para daños críticos a la seguridad nacional, la protección y la sociedad.

Los países han acordado que el «Padrino de la IA», Yoshua Bengio, dirigirá la entrega de un informe sobre el «Estado de la ciencia», que ayudará a construir una comprensión compartida de las capacidades y los riesgos que plantea la IA de frontera.

Los países y empresas que desarrollan IA de vanguardia han acordado un plan innovador sobre pruebas de seguridad de IA, mientras el Primer Ministro Rishi Sunak clausuraba la primera Cumbre de Seguridad de IA del mundo el jueves 2 de noviembre.

En una declaración sobre las pruebas, los gobiernos y las empresas de IA reconocieron que ambas partes tienen un papel crucial que desempeñar en las pruebas de la próxima generación de modelos de IA, para garantizar la seguridad de la IA, tanto antes como después de que se implementen los modelos.

Esto incluye colaborar para probar la próxima generación de modelos de IA frente a una variedad de capacidades potencialmente dañinas, incluida la seguridad nacional crítica, la protección y los daños sociales.

Han acordado que los gobiernos tienen un papel a la hora de velar por que se realicen pruebas de seguridad externas de los modelos de IA de frontera, lo que marca un alejamiento de la responsabilidad de determinar la seguridad de los modelos de IA de frontera que recaen únicamente en las empresas.

Los gobiernos también alcanzaron la ambición compartida de invertir en la capacidad del sector público para realizar pruebas y otras investigaciones sobre seguridad; compartir los resultados de las evaluaciones con otros países, cuando sea relevante, y trabajar para desarrollar, en su debido momento, estándares compartidos en esta área, sentando las bases para futuros avances internacionales en materia de seguridad de la IA en los próximos años.

La declaración se basa en la Declaración de Bletchley acordada por todos los países que asistieron el primer día de la Cumbre de Seguridad de la IA. Es uno de los varios pasos importantes hacia la construcción de un enfoque global para garantizar una IA segura y responsable que se ha logrado en la Cumbre, como el lanzamiento pionero en el Reino Unido de un nuevo Instituto de Seguridad de IA.

Los países representados en Bletchley también acordaron apoyar al profesor Yoshua Bengio, académico de IA ganador del Premio Turing y miembro del Consejo Asesor Científico de las Naciones Unidas, para liderar el primer informe sobre el «Estado de la ciencia» de la IA en la frontera. Esto proporcionará una evaluación científica de la investigación existente sobre los riesgos y capacidades de la IA de vanguardia y establecerá las áreas prioritarias para futuras investigaciones que sirvan de base para el trabajo futuro sobre la seguridad de la IA.

Las conclusiones del informe respaldarán futuras cumbres sobre seguridad de la IA, cuyos planes ya se han puesto en marcha. La República de Corea acordó ser coanfitrión de una mini cumbre virtual sobre IA en los próximos 6 meses. Francia será entonces la sede de la próxima Cumbre presencial dentro de un año.

El Primer Ministro Rishi Sunak dijo:

Hasta ahora, las únicas personas que han probado la seguridad de los nuevos modelos de IA han sido las mismas empresas que los desarrollan. No deberíamos depender de ellos para que corrijan sus propios deberes, como muchos de ellos coinciden.

Hoy hemos llegado a un acuerdo histórico en el que los gobiernos y las empresas de inteligencia artificial trabajan juntos para probar la seguridad de sus modelos antes y después de su lanzamiento.

El Instituto de Seguridad de la IA del Reino Unido desempeñará un papel vital a la hora de liderar este trabajo, en asociación con países de todo el mundo.

La Secretaria de Estado de Ciencia, Innovación y Tecnología, Michelle Donelan, dijo:

Las medidas que hemos acordado tomar en los últimos dos días ayudarán a la humanidad a aprovechar las oportunidades para mejorar la atención médica, la productividad en el trabajo y la creación de industrias completamente nuevas que una IA segura y responsable está destinada a desbloquear.

Garantizar que la IA funcione para el bien de todos nosotros es un esfuerzo global, pero estoy orgullosa del papel singular que ha desempeñado el Reino Unido al reunir a gobiernos, empresas y pensadores para acordar pasos concretos hacia un futuro más seguro.

Yoshua Bengio dijo:

El desarrollo seguro y responsable de la IA es una cuestión que nos concierne a todos. Hemos visto inversiones masivas para mejorar las capacidades de la IA, pero no suficiente inversión para proteger al público, ya sea en términos de investigación de seguridad de la IA o en términos de gobernanza para garantizar que la IA se desarrolle en beneficio de todos.

Me complace apoyar la tan necesaria coordinación internacional para la gestión de la seguridad de la IA, trabajando con colegas de todo el mundo para presentar la evidencia más reciente sobre este tema de vital importancia.

El Reino Unido ya ha tomado la iniciativa en estos esfuerzos al lanzar el Instituto de Seguridad de la IA, para desarrollar la capacidad del sector público para realizar pruebas de seguridad e investigaciones sobre la seguridad de la IA.

El informe «Estado de la ciencia», que será dirigido por el profesor Yoshua Bengio, ganador del premio Turing, ayudará a los responsables de políticas de IA en el Reino Unido y a nivel internacional a mantenerse al tanto del rápido ritmo de cambio en la IA, junto con un grupo de destacados académicos de todo el mundo. mundo.

Como el científico informático más citado del mundo, fundador del internacionalmente reconocido Instituto de IA Mila – Quebec y asesor tanto del gobierno del Reino Unido como de la ONU, el profesor Bengio se encuentra en una posición única para liderar este trabajo.

Las bases sentadas en Bletchley Park durante los últimos dos días serán fundamentales para garantizar que se pueda aprovechar el enorme potencial de la IA, de manera segura y responsable, para desbloquear un cambio en lo que es posible en términos de productividad económica, atención médica, educación y más.

Apoyo de los países a la Cumbre de Seguridad de la IA

El Viceprimer Ministro de Australia, Richard Marles, dijo:

Australia acoge con agrado un enfoque de seguridad desde el diseño en el que los desarrolladores asuman la responsabilidad. Los compromisos voluntarios son buenos, pero no tendrán sentido sin una mayor rendición de cuentas. Australia se complace en asociarse con el Reino Unido en esta importante labor.

El Ministro canadiense de Innovación, Ciencia e Industria, el Honorable François-Philippe Champagne, dijo:

Canadá acoge con satisfacción el lanzamiento del Instituto de Seguridad de IA del Reino Unido. Nuestro gobierno espera trabajar con el Reino Unido y aprovechar el conocimiento y la experiencia excepcionales de Canadá en IA, incluido el conocimiento desarrollado por nuestros institutos de IA para respaldar el desarrollo seguro y responsable de la IA.

La presidenta de la Comisión Europea, Ursula von der Leyen, dijo:

En los albores de la era de las máquinas inteligentes, los enormes beneficios de la IA sólo pueden cosecharse si también disponemos de barreras contra sus riesgos. Cuanto mayor sea la capacidad de la IA, mayor será la responsabilidad. Una gobernanza internacional creíble debe basarse en cuatro pilares: una comunidad científica independiente y con buenos recursos; procedimientos y normas de prueba ampliamente aceptados; la investigación de cada incidente significativo causado por errores o mal uso de la IA; y un sistema de alertas alimentado por señalizadores confiables. Es hora de actuar.

El gobierno francés dijo:

Las autoridades francesas participarán en esta iniciativa movilizando a las partes interesadas y los recursos que ya están activos en la seguridad de la IA, en particular las instalaciones de prueba y experimentación de Digital Europe para socios de IA y el programa francés Confiance.ai.

El gobierno alemán dijo:

Alemania está interesada en la creación del Instituto de Seguridad de la IA y espera explorar posibilidades de cooperación.

La primera ministra de Italia, Georgia Meloni, dijo:

La inteligencia artificial está entrando en todos los ámbitos de nuestras vidas. Hoy es nuestra responsabilidad dirigir su desarrollo ético y garantizar su plena alineación con la libertad, el control y la prosperidad de la humanidad. Necesitamos desarrollar la aplicación práctica del concepto de «Algor-ética», es decir, ética de los algoritmos.

El gobierno japonés dijo:

El gobierno japonés aprecia el liderazgo del Reino Unido en la celebración de la Cumbre de Seguridad de la IA y acoge con satisfacción la iniciativa del Reino Unido de establecer el Instituto de Seguridad de la IA del Reino Unido. Esperamos trabajar con el Reino Unido y otros socios en cuestiones de seguridad de la IA para lograr una IA segura y confiable.

La ministra de Comunicaciones e Información de Singapur, Josephine Teo, dijo:

La rápida aceleración de la inversión, el despliegue y las capacidades de la IA traerá enormes oportunidades para la productividad y el bien público. Creemos que los gobiernos tienen la obligación de garantizar que la IA se implemente de forma segura. Estamos de acuerdo con el principio de que los gobiernos deberían desarrollar capacidades para probar la seguridad de los sistemas fronterizos de IA.

Tras los MoU sobre tecnologías emergentes y cooperación de datos firmados por Singapur y el Reino Unido a principios de este año, hemos acordado colaborar directamente con el Reino Unido para desarrollar capacidades y herramientas para evaluar modelos de IA de vanguardia. Esto implicará una asociación entre la Autoridad de Desarrollo de Medios Infocomm de Singapur y el nuevo Instituto de Seguridad de IA del Reino Unido. El objetivo es construir una comprensión compartida de los riesgos que plantea la IA de frontera. Esperamos trabajar junto con el Reino Unido para desarrollar experiencia técnica y de investigación compartida para alcanzar este objetivo.

La Secretaria de Comercio de Estados Unidos, Gina Raimondo, dijo:

Acojo con beneplácito el anuncio del Reino Unido de establecer un Instituto de Seguridad de la IA, que trabajará en estrecha colaboración con el Instituto de Seguridad de la IA de Estados Unidos para garantizar el desarrollo y uso seguro y confiable de la IA avanzada. La IA es la tecnología que define a nuestra generación y conlleva un enorme potencial y un profundo riesgo. Nuestros esfuerzos coordinados a través de estos institutos son solo el comienzo de acciones para facilitar el desarrollo de estándares de seguridad, crear capacidades de prueba para modelos avanzados de IA y ampliar el intercambio de información, la colaboración en investigación, la interoperabilidad y la alineación de políticas en todo el mundo sobre la seguridad de la IA.

Soporte de la empresa

Demis Hassabis, cofundador y director ejecutivo de Google DeepMind dijo:

La IA puede ayudar a resolver algunos de los desafíos más críticos de nuestro tiempo, desde curar enfermedades hasta abordar la crisis climática. Pero también presentará nuevos desafíos para el mundo y debemos garantizar que la tecnología se construya y se implemente de manera segura. Para lograrlo será necesario un esfuerzo colectivo de los gobiernos, la industria y la sociedad civil para informar y desarrollar pruebas y evaluaciones de seguridad sólidas. Me emociona ver que el Reino Unido lanza el Instituto de Seguridad de la IA para acelerar el progreso en este trabajo vital.

Dario Amodei, cofundador y director ejecutivo de Anthropic dijo:

Si bien la IA promete importantes beneficios sociales, también plantea una serie de daños potenciales. Para gestionar estos riesgos es fundamental la capacidad del gobierno para medir y monitorear la capacidad y las características de seguridad de los modelos de IA. El AI Safety Institute está preparado para desempeñar un papel importante en la promoción de evaluaciones independientes en todo el espectro de riesgos y el avance de la investigación fundamental en seguridad. Damos la bienvenida a su creación y esperamos colaborar estrechamente para promover una IA segura y responsable.

Fuente:gov.uk