Uno dei temi più attesi nella Conferenza degli Ambasciatori del Sovrano Militare Ordine di Malta è stata l’intervista del corrispondete di The Times in Italia, Tom Kington al Reverendo Padre Paolo Benanti.

Il Padre Paolo Benanti è professore straordinario alla Facoltà di Teologia della Pontificia Università Gregoriana e Consigliere di Sua Santità per i temi legati all’intelligenza artificiale, è anche Consigliere per il Governo italiano e per l’ONU, da poco è stato nominato Distinguished Visiting Professor all’Università di Seattle. È un Frate Francescano.

In una recente intervista lei mi ha detto che non è l’intelligenza artificiale che spaventa ma la stupidità naturale, cosa vuol dire questo?

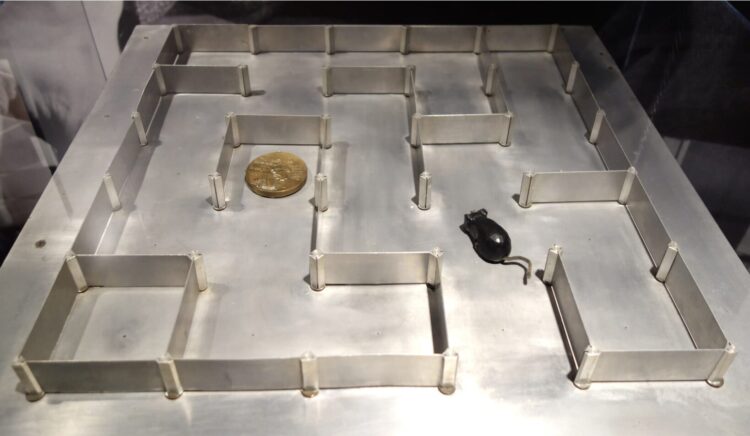

Nella relazione tra l’uomo e la macchina la risorsa ma anche il problema è sempre la parte umana nel senso che per quanto possa essere, come dire, potente l’intelligenza artificiale, l’intelligenza artificiale da sola non si applicherà mai ad ambiti della realtà a meno che l’uomo non voglia far sì che l’intelligenza artificiale faccia questo, e quindi il vero problema è conoscere la natura dello strumento. È uno strumento che di fatto prosegue quello che è una linea ormai antica, la linea della rivoluzione industriale e quel processo di automazione che abbiamo iniziato ormai più di 150/200 anni fa, ora conosce nuovi utensili, questi nuovi utensili però hanno una caratteristica nuova, se nelle prime forme di automazione industriale, sostanzialmente quello che succedeva era che la macchina poteva surrogare il muscolo nel processo di produzione, da quando abbiamo iniziato a utilizzare l’ informazione per controllare la macchina ecco che abbiamo visto che usata secondo alcuni schemi particolari la macchina poteva in qualche misura acquisire un fine e scegliere i mezzi poi per realizzare tale fine. Il primo esempio di questo tipo ce l’abbiamo con un piccolo topolino meccanico sviluppato da Claude Elwood Shannon nei laboratori della Bell APS dopo la guerra, il quale lasciato all’interno di un labirinto tutto cablato sbattendo a ogni singola parete effettuava una rotazione di 90° e urto dopo urto, trovava l’uscita del labirinto.  Ecco, faceva una cosa simile a quella che potrebbe fare un animale con una certa forma di intelligenza che riusciva dato un fine a trovare i mezzi per raggiungere quel fine. Adesso, per essere brevi su un tema che altrimenti sarebbe anche troppo esteso, dobbiamo chiederci eticamente, chiaramente “il fine non giustifica i mezzi”, ma come garantire che i mezzi scelti dalla macchina siano sempre adeguati ai fini che non siano sproporzionati. Potrebbe capitare, e questo è un esperimento che io stesso ho fatto con una intelligenza artificiale medica quando mi hanno chiesto di metterla alla prova, che l’intelligenza artificiale trovi dei mezzi che non sono assolutamente compatibili con quello che noi capiamo essere la dignità della persona umana. Ho chiesto a questa intelligenza artificiale qual era il metodo, il modo per togliere, per far sparire il cancro dalla faccia della terra. Ora io sapevo che facevo alla macchina una domanda pericolosa perché la macchina ottimizza una funzione e quindi avrebbe cercato lo zero della funzione, il primo zero che ha trovato la macchina è stato quello di uccidere tutti gli uomini, che oggettivamente funziona però non so se è il mezzo che noi riputiamo adatto. Ecco quindi quando dicevamo che il problema non è l’intelligenza artificiale ma è la stupidità naturale, il problema in questo caso, sarebbe nella parte umana che avrebbe dovuto validare lo strumento e decidere quali sono i confini di sicurezza per poter applicare quello strumento.

Ecco, faceva una cosa simile a quella che potrebbe fare un animale con una certa forma di intelligenza che riusciva dato un fine a trovare i mezzi per raggiungere quel fine. Adesso, per essere brevi su un tema che altrimenti sarebbe anche troppo esteso, dobbiamo chiederci eticamente, chiaramente “il fine non giustifica i mezzi”, ma come garantire che i mezzi scelti dalla macchina siano sempre adeguati ai fini che non siano sproporzionati. Potrebbe capitare, e questo è un esperimento che io stesso ho fatto con una intelligenza artificiale medica quando mi hanno chiesto di metterla alla prova, che l’intelligenza artificiale trovi dei mezzi che non sono assolutamente compatibili con quello che noi capiamo essere la dignità della persona umana. Ho chiesto a questa intelligenza artificiale qual era il metodo, il modo per togliere, per far sparire il cancro dalla faccia della terra. Ora io sapevo che facevo alla macchina una domanda pericolosa perché la macchina ottimizza una funzione e quindi avrebbe cercato lo zero della funzione, il primo zero che ha trovato la macchina è stato quello di uccidere tutti gli uomini, che oggettivamente funziona però non so se è il mezzo che noi riputiamo adatto. Ecco quindi quando dicevamo che il problema non è l’intelligenza artificiale ma è la stupidità naturale, il problema in questo caso, sarebbe nella parte umana che avrebbe dovuto validare lo strumento e decidere quali sono i confini di sicurezza per poter applicare quello strumento.

Quando parliamo di un Trattato Internazionale come può funzionare e che forma prenderebbe?

È chiaro che più ci astraiamo da un livello nazionale, più le cose sono anche fragili e deboli. È evidente che noi abbiamo conosciuto la più grande stagione di pace che ricordiamo ultimamente, anche se l’abbiamo chiamata “guerra fredda”, in forza anche di questi Trattati Internazionali. Pensiamo a quello che abbiamo fatto “Trattato Start” sulle armi nucleari o quant’altro, dove oggettivamente c’era bisogno non solo del trattato ma di costruire un clima di dialogo e di crescente fiducia, e vediamo adesso come gli effetti del “Trattato Start” sembrano non essere più adeguati a gestire la complessità. Quindi, questa è una cosa che emerge anche nei lavori delle Nazioni Unite è importante la diplomazia, è importante quella capacità di dialogo, è importante riuscire a mediare nei territori di dialogo nei quali si possa instaurare quella che normalmente si chiama una “win-win situation” cioè una situazione in cui l’equilibrio di interessi tra le parti ha maggiore interesse a mantenere l’equilibrio che non a fare altre relazioni. Questo ha bisogno chiaramente non solo di preparare il terreno culturalmente perché emerga una necessità culturale di tale trattato ma anche di individuare qual è l’organismo più adatto e la forma più efficace per fare tutto questo. C’è qui una sfida particolare, non riguarda direttamente le intelligenze artificiali, ma per evidenziare qual è la differenza radicale tra il mondo digitale e il mondo tradizionale. Quando abbiamo fatto un trattato sulle armi nucleari un trattato di non proliferazione, uno dei modi era quello di garantire, con alcune ispezioni di verificare gli arsenali. Se noi andiamo in un altro settore bellico quello che oggi è caratterizzato dalle cosiddette armi Cyber, noi possiamo pensare di fare un Trattato Internazionale sulle armi Cyber come lo abbiamo fatto per esempio sulle armi nucleari biologiche e chimiche, però c’è un problema fondamentale, il primo problema fondamentale è capire lo stoccaggio di queste armi perché se dei missili nucleari occupano uno spazio e un luogo, un’arma Cyber non solo non occupa uno spazio e un luogo ma non la dichiaro fino a quando non mi serve perché il giorno che la dichiarasse l’altro può avere già una contromisura, quindi è chiaro che quando parliamo del digitale parliamo di qualcosa che può avere degli effetti reali molto potenti e parlo a un Ordine (Sovrano Militare Ordine di Malta) che è famoso anche per il suo servizio ospedaliero, pensate cosa vuol dire se uno blocca con un ransomware o criptando tutti i dati di un ospedale, si possono avere delle vittime fisiche con uno strumento che fisico non è, e questo può produrre degli effetti come dire notevoli anche nell’ambito fisico. La sfida della normazione o la sfida dell’individuazione di questo luogo di dialogo è anche legata alla natura specifica dello strumento che forse facciamo ancora un po’ fatica a riconoscere perché lo pensiamo “soft” come il software e non lo riconosciamo “hard” cioè capace di avere degli effetti reali e potenti all’interno di uno spazio fisico

A Silicon Valley loro spesso pensano di aver risolto tutto intorno all’AI utilizzando una filosofia, una scuola di pensiero, che si chiama “effective altruism” qualcosa su cui lei aveva diversi dubbi. Che dubbi ha?

Sì, questa è una novità sulla quale vale la pena riflettere anche fosse solo da un punto di vista culturale, cioè l’idea che queste nuove tecnologie non nascono in un vuoto irreale ma nascono all’interno di un milieu culturale, nascono all’interno di una serie di relazioni che esprimono comunque dei desideri, dei sogni, delle preoccupazioni, delle attitudini riverso al mondo. Quindi l’artefatto tecnologico in quanto tale non è mai neutrale e questa è forse il contributo più bello che l’etica della tecnologia ha dato negli ultimi 30 anni, quando Langdon Winner a un certo punto ha mostrato qual era il compito dell’etica, della tecnologia, lui lo ha fatto analizzando quello che erano le costruzioni innovative che erano fatte in America in particolare c’era un esempio che piaceva Winner che era l’esempio della Parkway, dell’autostrada che connette Manhattan a Jones Beach in Long Island. Questa autostrada è stata voluta da un grande politico statunitense newyorkese che è Robert Moses, se uno legge la biografia di Moses, che è un testo di oltre 1,000 pagine scritto da Robert Caro vincitore di un Pulitzer, uno dei 100 Best Nonfiction Book in US Markets, trova una cosa specifica, Winner ci racconta che Moses aveva delle chiare e formali idee politiche, per Moses la parte migliore della città doveva essere per le persone migliori ed ecco che i ponti sulla Parkway oltre a non aver realizzato nessuna linea pubblica però sono costruiti due piedi, 60 cm, più bassi dello standard, nessun autobus può passare lungo quella Highway e quindi solo chi si poteva permettere una macchina all’epoca: la White Middle Class poteva permettersi di andare a Jones Beach. Ora se la cosa fosse stata fatta apposta per avere uno stigma sociale o no è molto discussa, di fatto però rimane una cosa che quella Highway è chiaramente una forma d’ordine una disposizione di potere sociale.

Quello che una volta facevano i ponti in calcestruzzo e l’asfalto, oggi è fatto dagli algoritmi. Quando in Italia abbiamo attraversato la pandemia un diritto fondamentale, il diritto alla salute, è stato ordinato nella popolazione tramite un algoritmo dietro un portale di sanità regionale che ha detto chi si sarebbe vaccinato prima e chi dopo, allora l’innovazione tecnologica ha sempre una dimensione etica politica e “Questioning Technologies” direbbe Landon Winner cioè mettere in discussione questo e offrirlo come caratteristica ai differenti stakeholder è qualcosa di fondamentale.

Qual è il milieu culturale della Silicon Valley oggi? ecco c’è questo altruismo efficace, dove l’altruismo efficace parte da un’idea molto seducente: facciamo le cose che hanno il miglior effetto per il maggior numero di persone, cioè una forma di utilitarismo se volete leggermente trasformata e modificata che dà ai grandi enterpreneur, ai grandi imprenditori della Silicon Valley, anche un senso di missione nella loro vita, perché spendere tante ore di lavoro tanti giorni, tanti sacrifici? Sì, uno potrebbe dire per il guadagno, ma il guadagno da solo non basta a giustificare il sacrificio di una vita, e allora l’idea di avere un purpose, di avere l’obiettivo di poter migliorare il mondo è un qualcosa di molto efficace.

Ahimè da eticista questa cosa mi lascia dei dubbi. C’è un piccolo e prezioso libro Edito dalla Cambridge Press negli anni ‘70 che si chiama “Utilitarianism For and Against”, dove in una maniera molto anglosassone con questo stile di pensiero molto puntuale e pulito, un autore parla a favore dell’utilitarismo, un autore cerca di far vedere i limiti dell’utilitarismo. Allora l’utilitarismo ha uno scopo molto nobile, fare il maggior bene possibile. La vera domanda che si fa un eticista è ma questo schema è praticabile in pratica o no?. L’esempio che c’è all’interno di questo libro secondo me è chiave perché l’autore dice «supponete di stare su una barca in mezzo a un lago e vedete una persona che sta per affondare ed è chiaro che salvarla anche da un punto di vista utilitaristico è un’azione che deve essere fatta perché l’effetto è un effetto positivo si salva una persona, ma se fosse stato Hitler?, e se fosse stato il padre di Hitler? e se fosse stato il nonno di Hitler? cioè dove questo calcolo di utilità si deve fermare per rendere l’azione giustificata e giustificabile?» Ora che questa forma di utilitarismo si sposta nel futuro, nell’altruismo efficace rimanendo nella metafora la domanda che ci dobbiamo fare è questo: quante generazioni devo essere disposto a sacrificare perché in futuro ci sia quell’effetto positivo che io dico di voler desiderare? Ecco il problema dell’altruismo efficace è che non è efficace il metodo cioè che non ci fornisce un metodo efficace per poter giustificare e argomentare le scelte che facciamo nell’oggi e rischia di trasformarsi in una sorta di nuovo paternalismo in cui pochi soggetti molto potenti decidono per tutti.

C’è un altro dubbio che lei ha messo su questo nuovo mondo è che tante data per nutrire l’AI viene messo da persone che parlano inglese dall’India più o meno. C’è questo rischio che diventano un tipo di nuovo “underclass” sfruttato in un senso abbastanza colonialistico?

Allora c’è un bellissimo pezzo di giornalismo investigativo del New York Times di 2/3 anni fa che va a investigare sostanzialmente chi e come fornisce quella che è la materia prima delle intelligenze artificiali per funzionare. Un’intelligenza artificiale sostanzialmente è uno strumento che si basa su due componenti: i dati e il potere computazionale. Il potere computazionale oggi è un problema perché la maggior parte dei chip viene prodotto a Taiwan, la situazione geopolitica conosce una forte tensione perché c’è una scarsità di risorse e la zona è particolarmente calda. Per quanto riguarda i dati, i dati non vanno solo raccolti ma vanno offerti alla macchina in qualche misura sistemati e puliti. Questo sistemare i dati, mi esprimo in termini molto generici per permetterci di capirci, e pulire i dati è un lavoro che fanno gli uomini, ci sono delle piccole frazioni cognitive della nostra capacità che vanno a operare sui dati

Interrompo un attimo perché io pensavo sempre che l’AI era capace di girare da solo nell’internet e trovare tutto quello che voleva ma in realtà non è così?

Quello è quello che vendono i commerciali. Allora ci sono dei sistemi che possono far questo ma anche per far questo devono essere prima basati su dei dati che sono addestrati cioè la parte di selezione dei dati è la parte più importante soprattutto per alcune missioni che sono “Mission Critical”. Se io voglio fare un’intelligenza artificiale che aiuta un radiologista o sostituisce un radiologo nell’analisi di una TAC Cut Scan, quei dati devono essere marcati cioè io devo dire alla macchina cos’è la parte buona dalla parte cattiva e quello costa lavoro umano è nel modello che ha caratterizzato il capitalismo recente, capitalismo della globalizzazione, l’idea è sempre stata quella di esternalizzare la parte più costosa e mantenere la parte più produttiva, la parte più produttiva è la realizzazione della tecnologia, la parte più costosa è la marcatura dei dati e allora ci sono compagnie come questa che è stata investigata da questo articolo del New York Times la E-Merit che nascono in India e prendono personale che prima si occupava d’ altro, dai lavori agricola ad altro, gli danno un breve formazione online magari con qualche medico che sta negli Stati Uniti e gli insegnano per esempio come si marca per la macchina una radiografia toracica facendo vedere quali sono le chiazze bianche che sono sospette, con 10-12 ore di lezione online, noi abbiamo queste batterie di persone sottopagate che fanno questo lavoro, dove non ci interessa tantissimo la precisione di marcatura perché potendolo fare più volte sostanzialmente si correggono tra loro, questa è l’idea che c’è dietro. L’idea del fatto che voi per esempio vedete in quel dispositivo che ogni tanto avrete visto su internet che si chiama “capcha”. Come faccio a riconoscere se ho una persona davanti o una macchina? gli chiedo di riconoscere, faccio il test di Touring inverso: un testo che so che una macchina non sa riconoscere. A un certo punto un brillante ingegnere ha detto: “scusate ma noi abbiamo il più potente dei computer al mondo il cervello umano a disposizione per 15 secondi, utilizziamolo”. E allora a fianco alla parola difficilmente comprensibile vi siete accorti che è comparso un pezzo di testo evidentemente estratto da una pagina digitalizzata, quindi con il primo pezzo io so che siete uomini, con il secondo pezzo vi chiedo cosa ci leggete, siccome quel chiedervi cosa ci leggete è gratis io lo posso far fare a 20.000 persone e quello che la maggior parte delle 20.000 persone mi dirà di quel testo è quello che si capisce del testo e allora ho iniziato a digitalizzare tutti i libri gratuitamente. La stessa cosa accade qua siccome pago molto poco le persone, se io chiedo a 20 persone di marcare per esempio una radiografia quello che la maggior parte delle persone fa e vede è quello che anche un radiologo medio farà e vedrà. Questo produce un qualcosa di molto strano, la nostra relazione al “Sud Globale” dove per “nostra” intendo occidentale non è sempre stata piana, prima abbiamo estratto le materie prime e le risorse, poi abbiamo estratto la forza lavoro anche con degli istituti che erano la schiavitù, ora rischiamo di estrarre questa che è questa capacità cognitiva in uno stile che di fatto potrebbe essere quello di un nuovo colonialismo digitale che sottrarrà a queste persone anche la capacità di stare sul mercato del lavoro globale perché quei lavoretti non serviranno più.